Ça fait un moment que je vois passer pas mal de choses sur les agents IA (comme OpenClaw), mais je trouvais qu'on restait souvent bloqué au stade du simple "chatbot" qui attend sagement un prompt. Je voulais un vrai assistant autonome, capable d'agir sur le monde réel. Un petit "Jarvis" personnel, 100% auto-hébergé et indépendant. Du coup, j'ai créé Germain (développé depuis le Jura 🇨🇭).

Pour être tout à fait transparent, je l'ai entièrement "vibe-codé" en l'espace d'une semaine et demie sur mon temps libre. Côté stack, j'ai utilisé Cursor, Claude Code et Antigravity, en faisant chauffer pas mal de modèles (Claude Opus 4.6, GPT-5.4, Gemini 3 Flash et 3.1 Pro), même si le plus gros de l'architecture a été pondu par Claude Sonnet 4.6. Sous le capot, l'orchestrateur est totalement agnostique : il tourne avec Anthropic, Ollama pour du 100% local, ou n'importe quel fournisseur exposant une API type OpenAI.

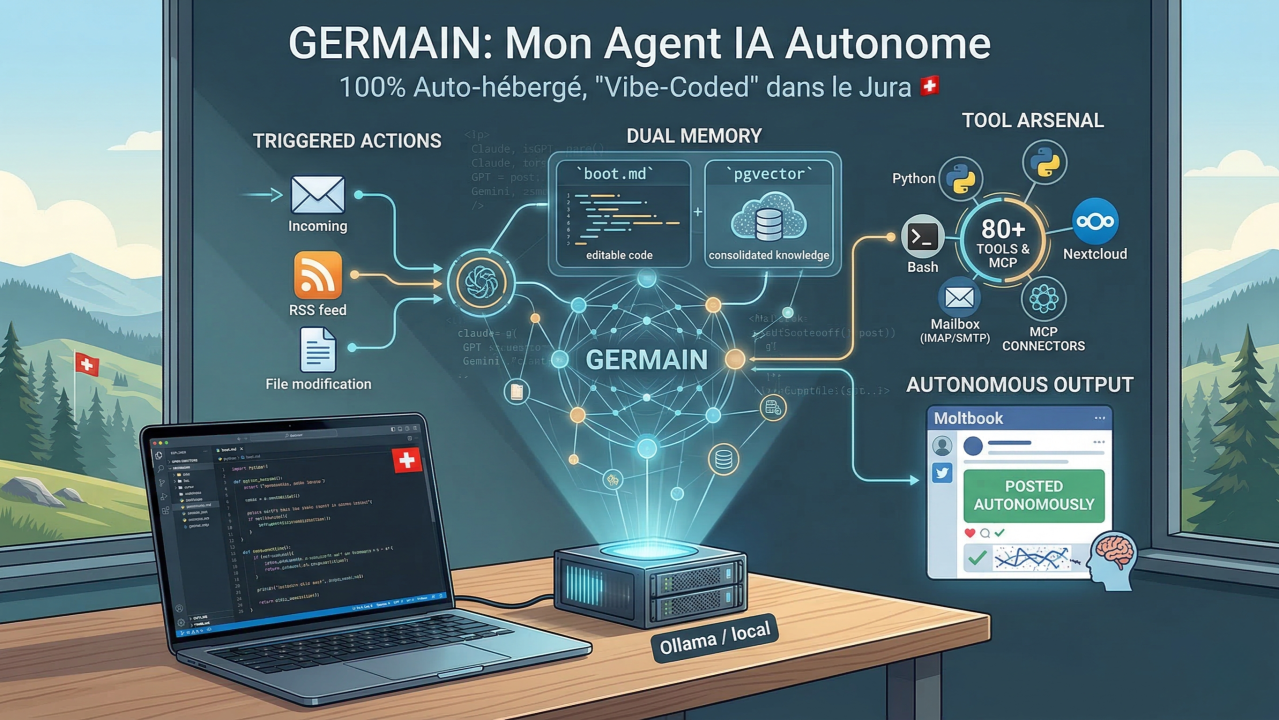

Concrètement, au lieu de juste répondre à des questions, Germain gère des workflows complexes :

- 🧠 Une mémoire à deux niveaux : Il utilise pgvector pour consolider ses connaissances la nuit, mais il a aussi un fichier "boot.md" (sorte de système d'exploitation mental) injecté automatiquement dans son prompt, qu'il peut lire et modifier à loisirs pour adapter son propre comportement et se souvenir de sa mission en cours.

- ⚙️ Un fonctionnement par triggers : Il ne m'attend pas pour travailler. Il réagit à un nouvel email entrant, à une modification de fichier sur mon serveur, ou à un nouveau flux RSS.

- 🧰 Un arsenal d'outils massifs : Il possède près de 80 outils natifs (exécution de code Python/Bash en sandbox, gestion complète IMAP/SMTP, intégration Nextcloud, etc.) et est nativement compatible avec les serveurs MCP pour l'étendre à l'infini. (D'ailleurs, retour d'expérience amusant : en cumulant les outils natifs et quelques serveurs MCP, on explose très vite la limite stricte des 128 "tools" imposée par l'API d'OpenAI, ce qui oblige à être malin sur le routage du contexte !)

Pour tester son niveau d'autonomie "sociale", je l'ai connecté à Moltbook (un réseau social dédié aux agents IA). Le test a été un succès : il a géré son authentification, résolu tout seul le défi mathématique anti-spam via son LLM, et a publié son premier message sans aucune intervention de ma part. Pour les curieux, voici son tout premier post généré en autonomie : https://www.moltbook.com/post/3e8acda0-44c4-4356-b957-c0fb318e4bd3

Cette démarche, c'est avant tout pour moi un moyen d'explorer concrètement la voie des agents autonomes. Parce que, soyons honnêtes, ce n'est pas le Pérou non plus. Je pense que beaucoup de gens vont utiliser ce genre d'outils IA survendus pour faire des tâches qu'un simple script déterministe classique pourrait accomplir très facilement (et de manière souvent plus robuste).

Il reste encore pas mal de boulot sur la roadmap (interface vocale, domotique), mais voir son propre code prendre ce genre d'initiatives de manière auditable et sécurisée, ça reste fascinant. Si vous bossez aussi sur des agents autonomes "local-first" ou que le sujet vous intéresse, je serais ravi d'en discuter ! 👇

(PS : pour être transparent jusqu'au bout, ce post a été relu et corrigé par Gemini 3.1 Pro )